Amazon SageMaker AIにおけるMLflow v3.10で生成AI開発を加速:エンドツーエンドのライフサイクル管理と高度な可観測性

Amazon SageMakerにおけるMLflow v3.10の革新的な統合

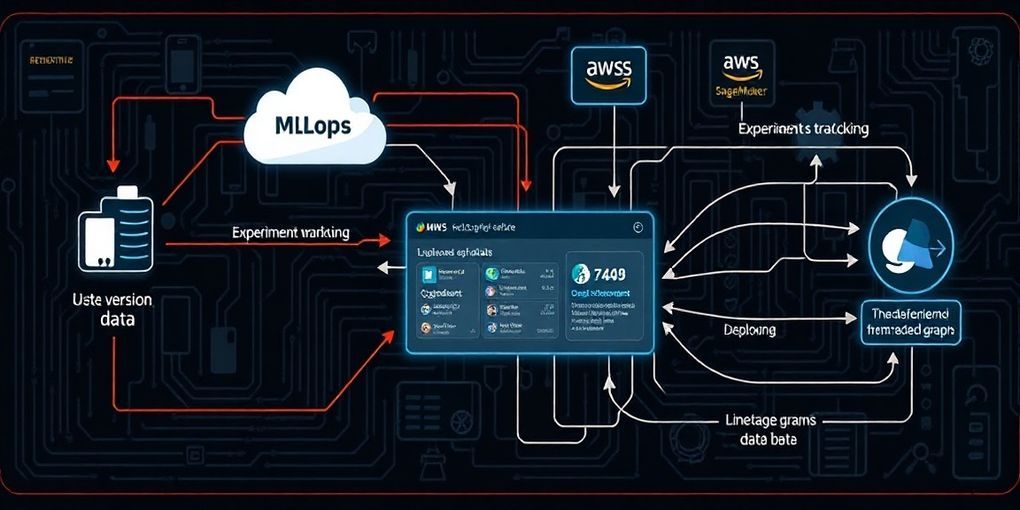

Amazon SageMaker AI MLflow AppsがMLflowバージョン3.10をサポートしたことにより、生成AI開発の効率化と実験追跡機能が大幅に強化されました。この最新バージョンは、Amazon SageMaker AI MLflow Appsの既存基盤を拡張し、データサイエンティストやMLエンジニアが実験段階から本番環境へのAIイニシアチブを加速できるよう、可観測性、評価、生成AI開発向けの強力な新機能を提供します。MLflow v3.10では、複雑なマルチターンワークフローに対するトレーシング機能が改善され、主要なLLMフレームワークやライブラリとの連携が強化され、生成AIのインタラクションや呼び出しのログ記録が効率化されています。これらの機能は、生成AIアプリケーションの構築を支援し、開発からプロダクションまでのライフサイクルを合理化します。

MLflow 3.0で確立された基盤の上に構築されており、生成AIアプリケーションの各ステップにおける入力、出力、メタデータを記録するトレーシング機能は、バグの特定や予期せぬ挙動の原因究明に役立ちます。 さらに、MLflow 3.0で導入されたLoggedModelエンティティは、生成AIエージェント、深層学習チェックポイント、モデルバリアントの整理と比較を可能にする第一級オブジェクトとして機能し、実験全体での包括的な系統管理を可能にします。 これにより、モデルの成果物、実行トレース、評価メトリクス、メタデータを開発ライフサイクル全体で統一的に追跡できます。

生成AIの評価と可観測性の革新

MLflow v3.10は、生成AIの品質測定と維持において大幅なアップグレードをもたらします。mlflow.genai.evaluation() APIは、関連性、忠実度、正確性、安全性といった組み込みメトリクスを含む、生成AIの品質を体系的に測定するためのプログラム可能なインターフェースを提供します。これらのメトリクスはAmazon SageMaker AIワークフローとシームレスに統合され、開発から本番環境まで一貫した品質管理を実現します。

可観測性の面では、より詳細なトレースフィルタリングと検索機能が追加され、デバッグや根本原因分析のためのリッチなメタデータキャプチャが可能になりました。また、レイテンシ分布、リクエスト数、品質スコア、トークン使用量など、ワークロードレベルのメトリクスを一目で把握できる事前構築済みのパフォーマンスダッシュボードが提供され、手動でのチャート設定なしに主要なパフォーマンス指標を可視化できます。 これにより、チームは問題の迅速な特定、エージェントの挙動の比較、パフォーマンスの最適化を容易に行うことができます。

Amazon SageMaker AI上のフルマネージドMLflowは、機械学習の実験追跡、再現性、デプロイメントの標準として確立されており、生成AIのワークフローに不可欠な監視、挙動観察、パフォーマンス評価の能力を提供します。 Amazon SageMaker Pipelinesとの統合により、サーバーレスなワークフローオーケストレーションサービスとして、機械学習オペレーション(MLOps)および大規模言語モデルオペレーション(LLMOps)の自動化を容易に構築、実行、監視できるため、生成AIのライフサイクル管理が一段と加速されます。

開発者・エンジニア視点での考察

-

統合されたライフサイクル管理による生産性向上: MLflow v3.10とAmazon SageMakerの組み合わせは、生成AIモデルの実験追跡からデプロイ、監視に至るまでのMLOpsサイクル全体を統合します。これにより、開発者はインフラ管理やツール間の連携に費やす時間を削減し、モデルの品質向上や新しい生成AIアプリケーションの革新に集中できます。特に、

LoggedModelエンティティによる系統管理とmlflow.genai.evaluation()APIによる品質評価の自動化は、反復的な開発プロセスにおける時間と労力を大幅に削減し、より迅速な市場投入を可能にします。 -

高度な可観測性によるデバッグと最適化の深化: マルチターン対話や複雑なエージェントワークフローを持つ生成AIアプリケーションにおいて、MLflow v3.10の強化されたトレーシング機能と詳細なメタデータキャプチャは不可欠です。これにより、予期せぬ出力やパフォーマンスの問題が発生した場合でも、入力から中間ステップ、出力までの詳細な実行パスを追跡し、根本原因を迅速に特定できます。事前構築済みのパフォーマンスダッシュボードは、レイテンシやトークン使用量などの運用メトリクスをリアルタイムで可視化し、モデルのコスト効率と応答品質の継続的な最適化を可能にします。

-

スケーラブルな生成AI評価フレームワークの活用:

mlflow.genai.evaluation()APIは、生成AIモデルの品質をプログラム的に測定するための標準化されたアプローチを提供します。開発者は、関連性、忠実度、正確性、安全性といった重要な指標を用いて、異なるモデルバージョンやプロンプト戦略の比較評価を自動化できます。このフレームワークは、SageMakerのインフラストラクチャ上でスケーラブルに実行できるため、大規模な実験やA/Bテストにおいて、客観的かつ一貫した評価を保証し、モデル改善のためのデータ駆動型意思決定を強力にサポートします。

Source / 元記事

この記事について

この記事は、公開されているニュース、論文、公式発表、RSSフィードなどをもとに、AIが要約・補足調査・考察を行って作成しています。

元記事の完全な翻訳・逐語的な要約ではなく、AIによる背景説明や開発者向けの考察を含みます。

重要な技術仕様・価格・提供状況などは、必ず元記事または公式情報をご確認ください。