SageMaker AIモデルとMLflowを活用したStrandsエージェント構築の技術的深掘り

StrandsエージェントのアーキテクチャとSageMaker AIによるモデルデプロイ

Strands Agents SDKは、モデル駆動型のアプローチを採用し、最小限のコードで堅牢なAIエージェントを構築・実行するためのオープンソースフレームワークです。エージェントは基本的に、モデル、システムプロンプト、および一連のツールの3つの主要コンポーネントで構成されます。このアーキテクチャにより、大規模言語モデル(LLM)は自律的に推論、計画、ツール利用を行い、複雑なタスクを遂行します。Strandsは、エージェントが会話を読み込み、行動を計画し、ツールを呼び出し、結果を統合して次のステップを決定する反復的な「エージェントループ」を中心に構築されています。このループは、エージェントが最終的な回答に到達するまで継続されます。Strandsは、Amazon Q DeveloperやAWS Glueなど、複数のAWSチームで本番環境のAIエージェントに利用され、その有効性が実証されています。

Amazon SageMaker AIは、Strandsエージェントの基盤モデルデプロイに不可欠な役割を果たします。企業がAIエージェントを構築する際、多くの場合、パフォーマンスチューニング、コスト最適化、コンプライアンス、データレジデンシー、モデル選択、既存のセキュリティアーキテクチャとの統合といった要件に対して、よりきめ細かい制御が必要となります。SageMaker AIエンドポイントは、これらの要件に対応し、コンピューティングリソース、スケーリング動作、インフラストラクチャの配置を制御しながら、AWSのマネージド運用レイヤーの恩恵を受けられます。SageMaker JumpStartから基盤モデルを展開することも、独自のカスタムモデルをデプロイすることも可能です。例えば、本稿ではSageMaker AI JumpStartで利用可能なQwen3 4BおよびQwen3 8BモデルがStrands Agentsで活用される方法が紹介されています。

さらに、Strands Agents SDKはSageMaker AIプロバイダーを実装しており、SageMaker AI推論エンドポイントにデプロイされたモデルに対してエージェントを実行できます。これには、SageMaker JumpStartの事前学習済みモデルとカスタムのファインチューニングモデルの両方が含まれます。Strands Agents SDKで使用するモデルは、OpenAI互換のチャット補完APIをサポートしている必要があります。ただし、カスタムLLMをSageMakerにデプロイする場合、その応答形式がStrandsエージェントが期待するBedrock Messages API形式と互換性がないという課題が生じる可能性があります。この問題を解決するためには、SageMakerAIModelを拡張し、モデルサーバーの応答形式をStrandsが期待する形式に変換するカスタムモデルパーサーを実装する必要があります。

SageMaker Serverless MLflowによるエージェントの観測性とMLOps

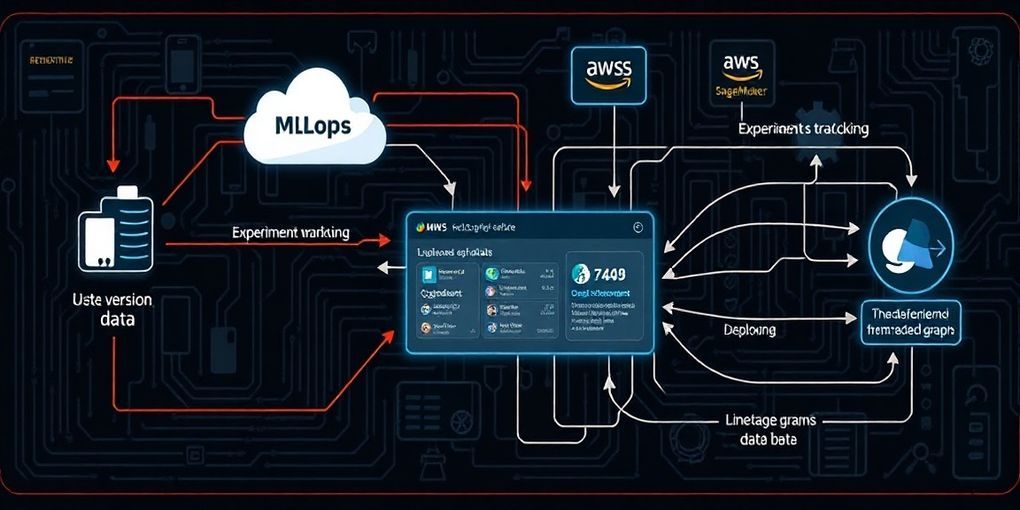

AIエージェントのライフサイクル管理と運用の効率化には、堅牢なMLOps(機械学習オペレーション)プラットフォームが不可欠です。Amazon SageMaker AI Serverless MLflowは、AIエージェントのための包括的なオブザーバビリティを提供し、エージェントの実行トレース、ツール使用パターン、意思決定ワークフローをカスタム計装なしで自動的にキャプチャします。このマネージドサービスは、運用オーバーヘッドを削減しつつ、Strands Agents SDKとのネイティブな統合を提供し、エージェントの会話フローの追跡を可能にします。

MLflowは、機械学習のライフサイクル全体(実験追跡、モデルバージョニング、デプロイ管理)を合理化するオープンソースツールです。SageMakerはMLflowと統合されており、パラメータ、メトリクス、モデルアーティファクト、環境の詳細を包括的に追跡できます。これにより、ロールバック、監査、コラボレーションが容易になります。特に、Managed MLflow 3.0は、ジェネレーティブAIの開発を加速させ、実験追跡からエンドツーエンドのオブザーバビリティまでを提供します。MLflow 3.0のトレーシング機能により、ジェネレーティブAIアプリケーションの各ステップにおける入力、出力、中間ステップ、メタデータを記録できるため、バグや予期せぬ動作の原因を迅速に特定できます。

Strands Agents SDKとMLflowの組み合わせは、エージェントのパフォーマンス評価と継続的な改善を可能にします。MLflowの指標を使用して複数のモデルバリアント間でのA/Bテストを実施し、エージェントのパフォーマンスを評価する機能が提供されます。MLflowの自動ロギング機能(mlflow.strands.autolog())を有効にすることで、エージェントの呼び出しに関するトレースが自動的にキャプチャされ、アクティブなMLflow Experimentにログされます。これにより、プロンプトと応答、レイテンシ、トークン使用量、コスト、キャッシュヒット、例外などの情報が自動的に追跡され、エージェントの挙動の深い洞察が得られます。

エンタープライズAIエージェント構築における統合ソリューションの利点

SageMaker AIモデルとMLflowを活用したStrandsエージェントの構築アプローチは、エンタープライズ環境におけるAIエージェント開発に複数の重要な利点をもたらします。第一に、組織はAIインフラストラクチャに対する柔軟性と制御を大幅に向上させることができます。SageMaker AI上にモデルをデプロイすることで、コンピューティングリソース、ネットワーク構成、スケーリングポリシーを正確に制御でき、特定のパフォーマンス、コスト、またはコンプライアンス要件を持つ組織にとって特に価値があります。

第二に、Strands Agents SDKの「モデル駆動型」アプローチとSageMakerのマネージドサービスとしての特性は、AIエージェントの開発期間を劇的に短縮します。複雑なワークフローをコードで手動定義する代わりに、LLMの推論能力を最大限に活用することで、開発者はエージェントのプロンプトとツールを定義するだけで、迅速にプロトタイプを作成し、本番環境にデプロイできます。これにより、Amazon Q Developerのようなチームでは、エージェント開発時間が数ヶ月から数日、数週間に短縮されたと報告されています。

最後に、SageMaker Serverless MLflowによる包括的なオブザーバビリティは、AIエージェントの信頼性と安定性を確保する上で不可欠です。エージェントの意思決定プロセスやツール利用の軌跡を詳細に追跡できるため、デバッグが容易になり、予期せぬ動作の原因を迅速に特定できます。さらに、MLflowのモデルバージョニングとA/Bテスト機能は、エージェントの継続的な改善とパフォーマンス最適化をサポートし、進化するビジネス要件に対応するための基盤を提供します。この統合ソリューションは、単なる技術的な組み合わせにとどまらず、エンタープライズレベルでのAIエージェントの構築、デプロイ、運用における課題を解決する戦略的なアプローチを提供します。

開発者・エンジニア視点での考察

-

エージェントインテリジェンスへの集中と運用抽象化のバランス: Strands Agents SDKは、プロンプトとツール定義を通じてエージェントのロジックをシンプルに表現することを可能にし、開発者がエージェントの「推論」と「行動」の設計に集中できるようにします。同時に、SageMaker AIは基盤モデルのデプロイとスケーリングを、MLflowは実験追跡とオブザーバビリティをマネージドサービスとして提供することで、複雑なインフラストラクチャ運用を抽象化しています。この分業により、開発者はMLOpsの複雑さに煩わされることなく、エージェントのインテリジェンスの反復的な改善にリソースを集中させることができ、結果として開発サイクルが加速します。

-

マルチモーダル・マルチエージェントシステムの開発基盤としての可能性: Strands Agents SDKは、そのモデル駆動型アプローチと柔軟なツール統合により、単一のタスクだけでなく、複数の専門エージェントが協調して動作する複雑なマルチエージェントシステムの構築にも適しています。SageMaker AIが提供する多様な基盤モデル(テキスト、画像生成など)をツールとして利用し、MLflowで各エージェントの行動や連携を詳細にトレースすることで、より高度なマルチモーダル処理や複雑なワークフローを自律的に実行するAIエージェントの開発、評価、デバッグがこれまで以上に効率的に行えるようになります。

-

レガシーシステムとの安全な統合とコンプライアンス対応: エンタープライズ環境においてAIエージェントを導入する際の大きな課題は、既存のレガシーシステムや機密データとの安全な統合です。SageMaker AIエンドポイントは、VPCやプライベートネットワークと連携し、データレジデンシーやアクセス制御を細かく設定できるため、コンプライアンス要件の高い業界でも安心して基盤モデルを利用できます。Strands Agentsが持つツール利用の概念は、これらの既存システムへのアクセスポイントを抽象化し、エージェントが安全かつ制御された方法で企業リソースと対話するためのメカニズムを提供します。これにより、セキュリティとコンプライアンスを確保しつつ、AIエージェントのビジネスへの適用範囲を広げることが可能になります。