AWS EC2 Capacity Blocks for MLとSageMakerトレーニングプラン:短期GPUキャパシティをセキュアに確保する技術的深掘り

機械学習ワークロード向けGPU確保の課題とAWSの回答

今日のAI開発において、GPUは計算能力のボトルネックとなることが多く、特に大規模な機械学習(ML)モデルのトレーニングや推論には、高性能なGPUインスタンスの安定した確保が不可欠です。しかし、GPU資源の需給逼迫は依然として顕著であり、オンデマンドでの利用では「InsufficientInstanceCapacity」エラーに直面したり、スポットインスタンスでは予期せぬ中断によりワークロードが遅延したりするリスクが常に存在します。この課題に対し、AWSは「EC2 Capacity Blocks for ML」と「Amazon SageMakerトレーニングプラン」という2つの補完的なサービスを提供し、短期的なGPUキャパシティの確実な確保と効率的な運用を実現します。

これらのサービスは、ML開発者や研究者が重要なプロジェクトのタイムラインを遵守し、リソースの可用性に関する懸念を最小限に抑えながら、イノベーションに集中できるように設計されています。GPU資源の確実な事前予約を可能にすることで、推論需要の急増、モデルのファインチューニング、迅速なプロトタイプ構築など、予測可能性と中断のない計算能力が求められる様々なMLワークロードに対応します。

EC2 Capacity Blocks for MLの技術的詳細とメカニズム

EC2 Capacity Blocks for MLは、将来の指定された期間に対して、特定のGPUインスタンスタイプのキャパシティを事前に予約できるサービスです。このモデルは、ホテルを予約するのと同様に機能し、ユーザーは必要なインスタンス数、開始日、期間を事前に決定します。

主要な技術的特徴:

- サポートインスタンスタイプ: 最新の高性能GPUを搭載したインスタンスタイプをサポートしており、NVIDIA Blackwell GPU搭載のP6e-GB200、P6-B300、P6-B200、NVIDIA H200/H100/A100 Tensor Core GPUを搭載したP5en、P5e、P5、P4dインスタンス、さらにはAWS Trainiumを搭載したTrn2およびTrn1インスタンスなどが利用可能です。

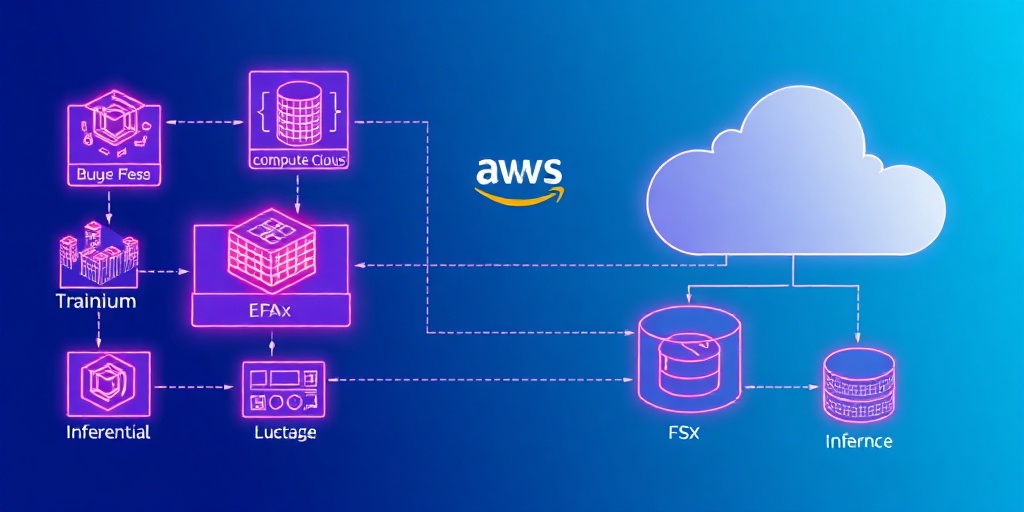

- UltraClustersでのコロケーション: 予約されたCapacity Blockは、Amazon EC2 UltraClusters内にコロケーションされます。UltraClustersは、高性能MLワークロードのために設計されており、Elastic Fabric Adapter (EFA) を用いたペタビットスケールのノンブロッキングネットワークにより、インスタンス間での超低遅延・高帯域幅通信を実現します。これにより、大規模な分散学習において最高のネットワークパフォーマンスが保証されます。

- 予約期間とリードタイム: 短期的なMLワークロードを対象とし、通常1日から14日間の期間で予約が可能です。最長で8週間先までの予約が可能ですが、柔軟な予約オプションとして最大6ヶ月の期間で、1〜64インスタンス(512 GPUまたは1024 Trainiumチップ)のクラスターサイズで予約できる場合もあります。

- 予測可能な価格: Capacity Blockの価格は、予約時に動的に決定されます。これにより、コストの予測可能性が高まり、予算管理が容易になります。一度購入したCapacity Blockはキャンセル不可であり、インスタンスタイプの変更もできないため、予約前の慎重な計画が必要です。

このメカニズムにより、開発者はGPUの可用性を心配することなく、指定された期間、高性能な計算リソースに確実にアクセスできます。

SageMakerトレーニングプランによるGPUキャパシティ管理の最適化

Amazon SageMakerトレーニングプランは、EC2 Capacity Blocks for MLの基盤の上に構築されたサービスで、機械学習のトレーニングジョブやSageMaker HyperPodクラスターのためにGPUキャパシティを事前に予約する機能を提供します。これにより、MLワークロードの実行に必要なインフラストラクチャのプロビジョニングと管理が自動化され、開発者はより高レベルな抽象化でキャパシティを確保できます。

主な機能と利点:

- 柔軟な予約オプション: インスタンスタイプ、数量、開始時間、期間を細かく指定してキャパシティを予約できます。これにより、特定のワークロード要件に合わせた最適なリソースを確保することが可能です。

- 自動化されたインフラプロビジョニング: トレーニングプランが承認されると、SageMakerは指定されたインフラストラクチャを自動的にプロビジョニングし、トレーニングジョブを実行します。これにより、手動での介入が不要となり、運用上の労力が大幅に削減されます。

- 予約の延長: 予期せぬ理由でMLワークロードの実行時間が長引いた場合でも、既存のトレーニングプランを延長できるようになりました。1日単位で最大14日間、または7日単位で最大182日間(26週間)まで延長可能であり、APIまたはSageMakerコンソールからシームレスに実施できます。これにより、中断なくワークロードを継続できます。

- 高可用性と耐障害性: SageMaker HyperPodと統合することで、基盤となるインフラストラクチャの障害を自動的に検出し、診断し、回復する弾力性の高いトレーニング環境を提供します。これにより、数ヶ月にわたる大規模な基盤モデル(FM)のトレーニングでも中断を最小限に抑え、トレーニング時間を最大40%短縮できる可能性があります。

- 「InsufficientInstanceCapacity」の解消: Capacity Blocksを基盤とすることで、GPUインスタンスが不足している状況でも、必要なキャパシティが保証され、MLワークロードの中断を防ぎます。

SageMakerトレーニングプランは、特に大規模なモデルの反復的な学習や、厳格な期限を持つプロジェクトにおいて、GPUキャパシティ管理を大幅に簡素化し、効率を向上させる強力なツールとなります。

開発者・エンジニア視点での考察

-

高優先度ワークロードの確実な実行戦略: 期限が厳しく、中断が許されないモデル学習やファインチューニングに対し、EC2 Capacity Blocksによる予測可能なGPU容量確保は、プロジェクトのタイムライン遵守に不可欠です。特に、生成AIモデル(LLMなど)の大規模な実験やリリース前の最終調整において、スポットインスタンスの変動リスクを排除し、安定した計算リソースを確保できる点は、開発チームの生産性とプロジェクトの信頼性向上に大きく貢献します。

-

コスト効率とリソースの最適化戦略: 短期間のGPU集中利用ニーズに対しては、オンデマンドインスタンスよりもコスト効率の良い選択肢を提供しつつ、長期コミットメントが不要なため、リソースの無駄を削減できます。動的な価格設定を考慮し、需要が低い時期や早期予約を活用することで、予算内で最大限のGPU時間を確保する戦略が有効です。ただし、一度予約したCapacity Blockは変更・キャンセル不可であり、インスタンスタイプ選定にはワークロードの特性を慎重に評価する必要があります。

-

MLOpsパイプラインへの統合と自動化: SageMakerトレーニングプランのAPIを活用することで、MLモデルのCI/CDパイプラインにGPUキャパシティ予約プロセスを組み込むことが可能になります。例えば、新しいモデルバージョンの自動ファインチューニングや、回帰テストのための短期的な大規模学習環境のプロビジョニングを自動化し、開発サイクルの迅速化と信頼性向上を図ることができます。SageMaker HyperPodとの連携により、より堅牢で自動化された分散学習環境を構築し、モデル開発の継続的なデリバリーを加速させることが期待されます。

Source / 元記事

この記事について

この記事は、公開されているニュース、論文、公式発表、RSSフィードなどをもとに、AIが要約・補足調査・考察を行って作成しています。

元記事の完全な翻訳・逐語的な要約ではなく、AIによる背景説明や開発者向けの考察を含みます。

重要な技術仕様・価格・提供状況などは、必ず元記事または公式情報をご確認ください。