エージェントシステムの複雑化に対応するNVIDIAの究極の共同設計戦略

エージェントシステムの新たな複雑性とパフォーマンス要件

生成AIの初期段階が人間からの要求に対するモデル応答という単純なインタラクションモデルで特徴づけられたのに対し、現在進行中の「エージェントAI」の章では根本的なパラダイムシフトが起きています。エージェントは、あらかじめ定められた一連のアクションに従うのではなく、ツールを呼び出し、異なるタスクやモデルを持つサブエージェントを生成し、情報をメモリに保持し、自身のコンテキストウィンドウを管理し、いつ作業を終了するかを自ら決定します。このような自律的な動作は、トークン消費量、コンテキスト長、およびレイテンシ要件を極めて高いレベルに押し上げます。

特に、エージェントワークロードは構造的に確率的なトークン消費パターンを引き起こし、従来のサービス提供の経済性を困難にしています。例えば、Claude Codeのような現実世界のエージェントセッションでは、コンテキストウィンドウあたりのトークン量が数万から15万トークン以上にスケールアップすることが示されています。これは、ツール呼び出しによる出力がコンテキストウィンドウに直接追加され、入力シーケンスに予測不能性をもたらすためです。このような複雑性の増大に対応するには、高モデルインテリジェンス、大規模コンテキスト、そして低レイテンシが不可欠であり、エージェントがより迅速に洞察を生成するほど、その価値は指数関数的に増大します。

究極の共同設計:ハードウェアとソフトウェアの融合

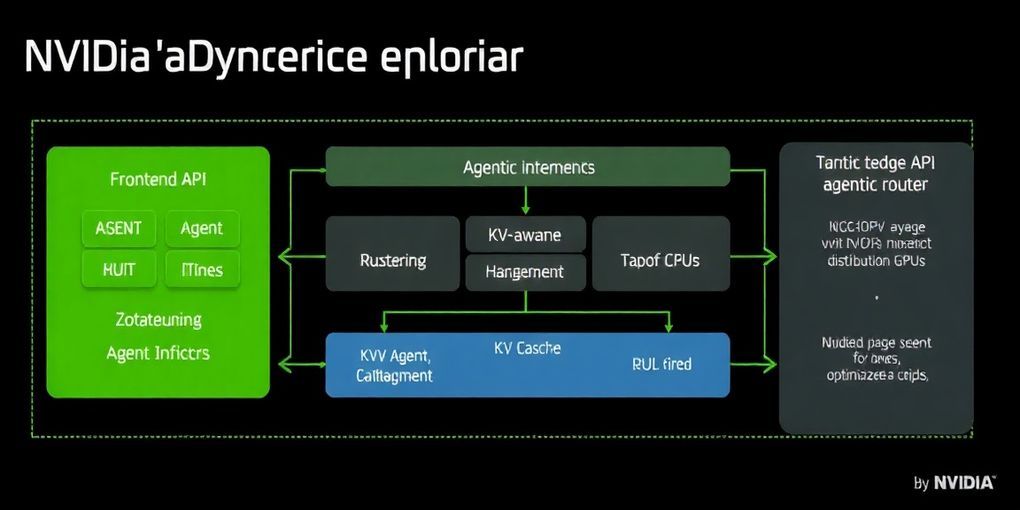

NVIDIAが提唱する「究極の共同設計(Extreme Co-Design)」とは、ハードウェア、ソフトウェア、アルゴリズム、データパイプライン、さらには物理インフラストラクチャといったスタックのあらゆる層を同時に共同設計するという根本的なアプローチを指します。これは、単に個々のチップを設計するだけでなく、AIデータセンター全体をデータからトークン(出力)を生成する「AI工場」として捉え、電力供給や冷却からトレーニングスループット、推論レイテンシまで、すべてを最適化することを目指します。

この戦略の核心は、性能、消費電力、コスト、フットプリントといった戦略的メトリクスを最大化することにあります。エージェントシステムの複雑性と変動性に対応するためには、GPU、インターコネクト、コンパイラ、CUDAやTensorRTなどのフレームワークが密接に連携し、特定のAIモデルのニーズに合わせたハードウェア設計が求められます。これにより、NVIDIAはチップの仕様だけでなく、システムレベルの経済性においても優位性を確立しようとしています。また、NVIDIAは、エージェントAIが小規模でオープンなモデルに大きく依存すると考えており、オープンソースAIへの貢献を強化しています。

NVIDIA Vera Rubinプラットフォーム:エージェントワークロードのための基盤

NVIDIA Vera Rubinプラットフォームは、増大するエージェントワークロードの複雑性に対処するために、究極の共同設計アプローチに基づいて構築された統合プラットフォームです。このプラットフォームは、7つのチップとソフトウェアスタックを組み合わせることで、大規模な400kコンテキストを持つ兆パラメータ規模のMoEモデルにおいて、ユーザーあたり毎秒400トークン以上のパフォーマンスを提供できます。

この性能レベルは、エージェントシステムにおける従来のトレードオフのパラダイムを変革します。もはや、高いユーザー速度とシステムスループットを実現するために、より小さなモデルと限られたコンテキストウィンドウで品質を妥協する必要がありません。Vera Rubinプラットフォームは、高度なプロンプトキャッシュ、コンテキスト圧縮、そしてNVIDIA CMXのような専用ハードウェアを活用し、経済性とレイテンシ効率を維持しながら、エージェントアーキテクチャを大規模なスケールで実現可能な製品にすることを目指しています。これにより、エージェントAIのポテンシャルを最大限に引き出し、R&Dサイクルの短縮、ハーネス制御の向上、複雑なマルチエージェントループの実現を可能にします。

開発者・エンジニア視点での考察

-

エージェントワークロードは、従来の単純なリクエスト/レスポンスモデルとは異なり、ツール呼び出し、サブエージェント生成、長期メモリ管理、動的なコンテキストウィンドウなど、予測不可能な要素が多いため、システムの設計においてエンドツーエンドのスタック最適化が不可欠です。個別のコンポーネント性能だけでなく、ハードウェアとソフトウェアのシームレスな統合によって、初めてその真価を発揮できます。

-

大規模なコンテキストウィンドウと高いトークンスループットを提供するVera Rubinのようなプラットフォームを活用することで、開発者は速度やコストを犠牲にすることなく、より洗練された、長期的なタスク計画能力を持つエージェントアプリケーションを構築できるようになります。これは、複雑なビジネスプロセス自動化や高度な研究シミュレーションなど、これまで困難だった領域でのAIエージェントの適用を促進します。

-

エージェントのトークン消費の予測不能性は、ソフトウェア開発において効率的なプロンプトキャッシングとコンテキスト圧縮戦略の重要性を強調します。開発者は、単に大きなモデルを使うだけでなく、トークン使用量をインテリジェントに管理し、不要な計算を削減する技術に注力することで、運用コストを削減し、エージェントの応答性を向上させることができます。

Source / 元記事

この記事について

この記事は、公開されているニュース、論文、公式発表、RSSフィードなどをもとに、AIが要約・補足調査・考察を行って作成しています。

元記事の完全な翻訳・逐語的な要約ではなく、AIによる背景説明や開発者向けの考察を含みます。

重要な技術仕様・価格・提供状況などは、必ず元記事または公式情報をご確認ください。