NVIDIA Nemotron-3 Super A 120B:エージェントワークロード向けオープンAIモデルの技術的深掘り

NVIDIAは、エージェントワークロード向けに設計された大規模なオープンAIモデル「Nemotron-3 Super A 120B」を発表しました。このモデルは、複雑な推論、コード生成、および長文コンテンツ作成において高い性能を発揮するよう構築されており、マルチエージェントシステムの「コンテキスト爆発」や「思考コスト」といった課題に対処することを目指しています。本レポートでは、Nemotron-3 Super A 120Bの技術的詳細、アーキテクチャ、および開発者にとっての意義を深く掘り下げます。

Nemotron-3 Super A 120Bの概要とエージェントAIへの応用

NVIDIA Nemotron-3 Super A 120Bは、合計1200億のパラメータを持ち、そのうち120億がアクティブに使用されるオープンウェイトの大規模言語モデル(LLM)です。Hugging Face、OpenRouter、Perplexity AI、およびNVIDIA NIMを通じて一般公開されており、開発者が自社のインフラストラクチャ上でモデルをダウンロード、ホスト、およびファインチューニングできる柔軟性を提供します。

本モデルの主要な焦点は「エージェントワークロード」であり、ITチケットの自動化、ソフトウェア開発、サイバーセキュリティのトリアージなど、複雑なタスクを自律的に実行するAIエージェントの能力を向上させることを目的としています。マルチエージェントシステムでは、履歴、ツール出力、推論ステップが各ターンで再送されるため、「コンテキスト爆発」が発生し、コスト増大やエージェントが元の目標を見失う「ゴールドリフト」を引き起こす可能性があります。Nemotron-3 Super A 120Bは、100万トークンという広範なコンテキストウィンドウをサポートすることで、この課題に対処し、エージェントがワークフロー全体の状態をメモリに保持できるようにします。

さらに、複雑なエージェントが各ステップで推論を行う必要があることによる「思考コスト」も、マルチエージェントアプリケーションの実用性を妨げる要因でした。Nemotron-3 Super A 120Bは、後述する革新的なアーキテクチャを通じて、この思考コストを削減し、高精度な推論性能を維持しながら、より効率的な運用を可能にしています。

革新的なハイブリッドMoEアーキテクチャと効率性

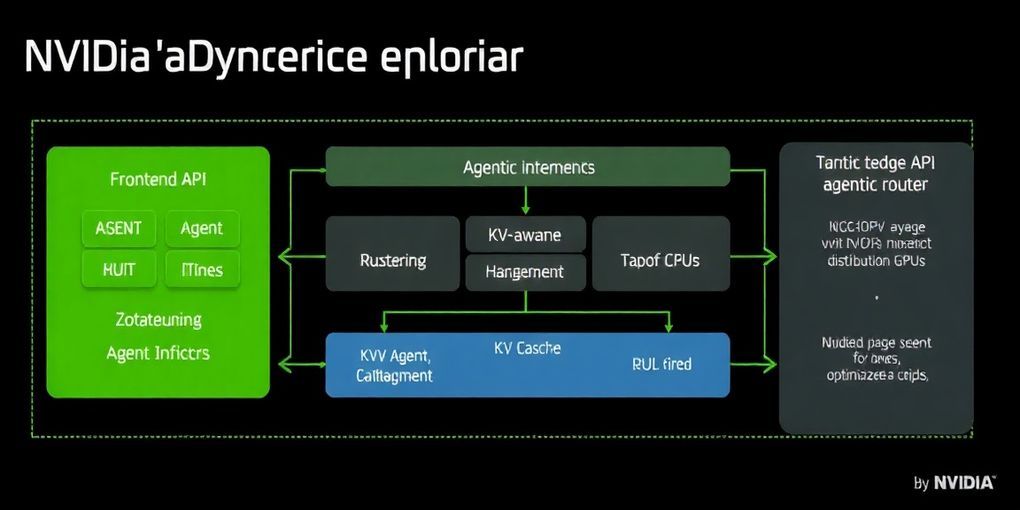

Nemotron-3 Super A 120Bの核となるのは、Mamba-2、Mixture-of-Experts(MoE)、およびAttention層を組み合わせたハイブリッドLatentMoEアーキテクチャです。このアーキテクチャは、推論効率と精度の両方を最大化するために、いくつかの重要な技術革新を導入しています。

LatentMoEとアクティブパラメータの最適化

本モデルは、合計1200億パラメータのうち、推論時にアクティブとなるのは120億パラメータのみという設計を採用しています。LatentMoEは、トークンをエキスパートにルーティングする前に、より小さな潜在次元に投影することで、同じ推論コストで4倍多くのエキスパートスペシャリストを呼び出すことを可能にします。これにより、FLOPあたりの精度とパラメータあたりの精度の両方を最適化し、高い推論性能を維持しながら計算効率を大幅に向上させます。

マルチトークン予測(MTP)とNVFP4量子化

Nemotron-3 Super A 120Bは、Multi-Token Prediction(MTP)層を組み込んでおり、1回のフォワードパスで複数の将来のトークンを予測できます。これにより、長文シーケンスの生成時間を劇的に短縮し、組み込みの投機的デコーディングを可能にすることで、モデル全体の品質も向上させます。

さらに、本モデルはNVIDIAのネイティブ4ビット浮動小数点形式であるNVFP4量子化を用いて事前学習されたNemotron 3ファミリー初のモデルです。ほとんどの線形層でNVFP4を使用することで、高精度を維持しつつ計算効率を最大化しています。

100万トークンのコンテキストウィンドウ

前述の通り、100万トークンという非常に長いコンテキストウィンドウは、マルチエージェントシステムの「ゴールドリフト」を防ぎ、エージェントが複雑なワークフロー全体にわたって一貫した長期記憶と推論能力を維持するために不可欠です。これは、Mamba層が線形時間で動作し、KVキャッシュの成長がないため、コンテキスト長に対する計算コストとメモリ消費を効率的に管理できることに起因しています。

Nemotron-3 Super A 120Bの性能とベンチマーク

Nemotron-3 Super A 120Bは、その革新的なアーキテクチャにより、エージェントワークロードにおいて顕著な性能向上を実現しています。NVIDIAは、以前のNemotron Superモデルと比較して、最大5倍のスループット向上を報告しています。

具体的なベンチマークでは、8k入力/64k出力のシナリオにおいて、Qwen3.5-122Bと比較して最大7.5倍、GPT-OSS-120Bと比較して最大2.2倍の推論スループットを達成しています。また、一般的なベンチマークにおいても、GPT-OSS-120BやQwen3.5-122Bと同等またはそれ以上の精度を示しており、高精度なツール呼び出し能力も備えています。

API経由での利用料金も、100万入力トークンあたり0.1ドル、100万出力トークンあたり0.5ドルと、そのクラスのモデルとしてはコスト効率の高い選択肢の一つとされています。

開発者・エンジニア視点での考察

-

オープンウェイト戦略によるエージェント特化型モデルの加速: Nemotron-3 Super A 120Bのオープンウェイトであるという特性は、開発者が独自のデータセットでモデルをファインチューニングし、ベンダーロックインやトークンあたりのコストを気にすることなく、特定の企業要件やドメイン知識に合わせた高度に専門化されたエージェントを構築する道を拓きます。これにより、機密性の高いデータを扱うエンタープライズ環境でのエージェントAIの採用が加速されるでしょう。

-

ハイブリッドMoEとMTPによる効率的なエージェントアーキテクチャの探求: LatentMoE、Mamba-2、Attention層のハイブリッド構成とMTPの統合は、「コンテキスト爆発」や「思考コスト」といったマルチエージェントシステムの根本的な課題に対するNVIDIAの具体的なソリューションを提示しています。開発者は、このアーキテクチャ設計を深く分析することで、自身のAIエージェントシステムにおいて、いかにして長期記憶、複雑な推論、および高速なテキスト生成を効率的に両立させるかについての新たな知見と実践的なアプローチを獲得できる可能性があります。

-

NVFP4量子化と100万トークンコンテキストによる実用的なエージェント展開: NVFP4による事前学習と100万トークンという広大なコンテキストウィンドウの組み合わせは、これまで研究室レベルに留まっていた複雑なマルチエージェントワークロード(例えば、コードベース全体を読み込んでデバッグする開発エージェントや、数千ページの金融文書を分析する金融エージェントなど)を、企業規模で経済的かつ実用的に展開するためのブレークスルーを提供します。開発者は、これらの技術的要素を既存のインフラストラクチャに統合することで、より野心的なエージェントベースのソリューションを設計・実装できるようになります。